機器學習被公式化為針對給定示例集(訓練集)的損失函數的“最小化問題”。 此功能表示由訓練模型預測的值與每個示例實例的期望值之間的差異。

最終目標是教模型具有在訓練集中不存在的一組實例上正確預測的能力。

一種可以區分不同算法類別的方法是某個系統的預期輸出類型 機器學習.

在主要類別中,我們發現:

分類的一個示例是根據圖像中包含的對像或主題為圖像分配一個或多個標籤;

回歸的一個示例是根據彩色圖像形式的場景表示來估計場景的深度。

實際上,所討論的輸出的範圍實際上是無限的,並且不限於某些離散的可能性。

線性回歸是廣泛用於估算實際價值的模型,例如:

並遵循連續變量的標準:

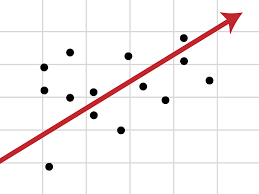

在線性回歸中,自變量和因變量之間的關係後接一條通常代表兩個變量之間關係的線。

擬合線稱為回歸線,並由Y = a * X + b類型的線性方程表示。

該公式基於內插數據,以將兩個或多個特徵彼此關聯。 當您為算法提供輸入特徵時,回歸將返回另一個特徵。

當我們有多個獨立變量時,我們將採用多元線性回歸,並假設模型如下:

y=b0 + B1x1 + B2x2 +…+ Bnxn

基本上,該方程式解釋了一個連續因變量(y)與兩個或多個自變量(x1,x2,x3…)之間的關係。

例如,如果我們要考慮發動機功率,汽缸數和燃料消耗來估算汽車的二氧化碳排放量(因變量y)。 後面這些因素是自變量x2,x1和x2。 常數bi是實數,稱為模型的估計回歸係數,Y是連續因變量,即b3,b0 x1,b1 x2等的總和。 y將是一個實數。

多元回歸分析是一種用於確定自變量對因變量的影響的方法。

了解因變量如何隨自變量變化而變化,使我們能夠預測實際情況中變化的影響或影響。

使用多元線性回歸,可以了解血壓如何隨著體重指數的變化而變化,並考慮到諸如年齡,性別等因素,從而假設可能發生的情況。

通過多元回歸,我們可以估算價格趨勢,例如石油或黃金的未來趨勢。

最後,多元線性回歸在機器學習和人工智能領域越來越引起人們的興趣,因為即使在要分析的記錄很多的情況下,多元線性回歸也可以獲取執行學習模型。

Logistic回歸是一種統計工具,旨在用一個或多個解釋變量對二項式結果進行建模。

它通常用於二進制問題,其中只有兩個類,例如“是”或“否”,“ 0”或“ 1”,“男”或“女”等。

以此方式,可以描述數據並解釋二進制因變量與一個或多個名義或序數無關變量之間的關係。

結果是通過使用邏輯函數來確定的,該函數估計概率,然後 defi結束與所獲得的概率值最接近的類別(正或負)。

我們可以考慮將邏輯回歸作為對家族的分類的一種方法 監督學習算法.

使用統計方法,邏輯回歸可以生成結果,該結果實際上表示給定輸入值屬於給定類別的概率。

在二項式邏輯回歸問題中,輸出屬於一類的概率為P,而輸出屬於另一類1-P(其中P是0到1之間的數字,因為它表示概率)。

二項式邏輯回歸在所有我們要預測的變量都是二進制的情況下均能很好地工作,也就是說,它只能採用兩個值:代表正類別的值1或代表負類別的值0。

邏輯回歸可以解決的問題示例如下:

使用Logistic回歸,我們可以進行預測分析,測量我們要預測的變量(因變量)與一個或多個自變量(即特徵)之間的關係。 概率估計是通過邏輯函數完成的。

隨後將概率轉換為二進制值,並且為了使預測成為真實,根據結果是否接近該類本身,將該結果分配給它所屬的類。

例如,如果邏輯函數的應用返回0,85,則表示輸入通過將其分配給類別1來生成一個正類別。相反,如果它已獲得諸如0,4或更一般地小於0,5的值, ..

邏輯回歸使用邏輯函數來評估輸入值的分類。

邏輯函數(也稱為Sigmoid)是一條曲線,它能夠獲取任意數量的實際值並將其映射到介於0和1之間的值(極值除外)。 該函數是:

其中:

Logistic回歸使用方程式表示,非常類似於線性回歸

使用權重或係數值對輸入值(x)進行線性組合,以預測輸出值(y)。 與線性回歸的主要區別在於,建模輸出值是二進制值(0或1),而不是數字值。

這是一個邏輯回歸方程的示例:

y = e ^(b0 + b1 * x)/(1 + e ^(b0 + b1 * x))

在哪裡:

輸入數據中的每一列都有一個相關的b係數(恆定的實數值),必須從訓練數據中學習。

您將存儲在內存或文件中的模型的實際表示形式是方程式中的係數(β或b值)。

Logistic回歸對默認類別的概率進行建模。

例如,假設我們正在根據人們的身高將人們的性別建模為男性或女性,第一類可能是男性,而邏輯回歸模型可以寫成在給定一個人的身高或更高時成為男性的概率。正式地:

P(性別=男性|身高)

換句話說,我們正在對輸入 (X) 屬於 pre 類的概率進行建模definite(Y = 1),我們可以將其寫為:

P(X)= P(Y = 1 | X)

為了實際進行概率預測,必須將概率預測轉換為二進制值(0或1)。

Logistic回歸是一種線性方法,但是使用logistic函數可以轉換預測。 這樣的影響是我們不再像線性回歸那樣將預測理解為輸入的線性組合,例如,從上面繼續,模型可以表示為:

p(X)= e ^(b0 + b1 * X)/(1 + e ^(b0 + b1 * X))

現在我們可以按如下方式反轉方程式。 要逆轉它,我們可以通過在另一側添加自然對數的方式來消除一側的e。

ln(p(X)/ 1-p(X))= b0 + b1 * X

這樣,我們得到一個事實,右邊的輸出的計算又是線性的(就像線性回歸一樣),左邊的輸入是默認類的概率的對數。

概率被計算為事件概率除以無事件概率的比值,例如 0,8 /(1-0,8)其結果為4。因此我們可以改寫為:

ln(奇數)= b0 + b1 * X

由於概率是對數轉換的,因此我們將其稱為左側對數或概率。

我們可以將指數返回到右側並將其寫為:

概率= e ^(b0 + b1 * X)

所有這些都有助於我們理解,模型確實仍然是輸入的線性組合,但這種線性組合指的是前類的對數概率defi妮塔。

在學習階段估計邏輯回歸算法的係數(β或b值)。 為此,我們使用最大似然估計。

最大似然估計是多種機器學習算法使用的學習算法。 模型得出的係數預測學前班的值非常接近 1(例如男性)defi晚上,另一個班級的值非常接近 0(例如女性)。 邏輯回歸的最大似然是查找係數值(Beta 或 ob 值)的過程,該值可最小化模型預測的概率相對於數據中的概率的誤差(例如,如果數據是主要類,則概率為 1) 。

我們將使用最小化算法為訓練數據優化最佳係數值。 這通常在實踐中使用有效的數值優化算法來實現。