這些機制使智能機器可以隨著時間的推移提高其功能和性能,通過自動學習經驗來執行某些任務,並隨著時間的推移越來越提高其性能。

一個例子是 AlphaGo, 為圍棋遊戲開發的機器學習軟件 DeepMind. AlpaGo 是第一個能夠在飛機上擊敗遊戲中的人類大師的軟件 戈班 標準尺寸(19 × 19)。 AlphaGo 軟件通過觀察圍棋玩家在不同遊戲中的數百萬步棋進行訓練,並讓機器與自己對戰,結果它能夠擊敗被認為是該遊戲世界上最好的棋手。

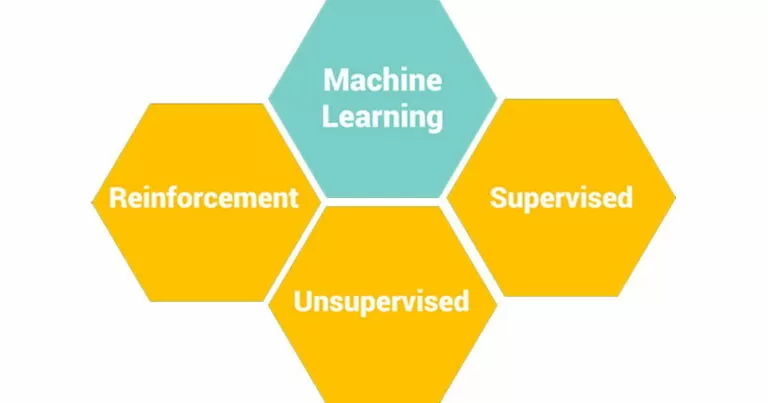

現在讓我們進入機器學習的三個主要類別。

系統接收根據所需輸出標記的示例。 也就是說,對指示機器有用的數據集是由代表由輸入數據組成的真實情況的元素組成的”功能“從輸出數據”目標”。 參考文章的例子 什麼是機器學習,它是關於什麼以及它的目標,訓練的準備是有監督的,因為我們有個別的路線案例,每個案例都指定了特徵(車輛、路線)和目標(旅行時間)。 數據集通常要復雜得多,示例極其有限且具有指導意義,目的是簡化對監督機器學習的理解。

這種類型的案例允許算法研究路線和車輛類型的基礎,可能是旅行時間。 監督機器學習中有兩種類型的問題:

重新考慮高速公路路線的例子,我們可以說它是一種回歸。 如果目標包括以下評估:如果不到一小時,則快,如果在 1 到 XNUMX 小時之間放慢,如果超過兩小時,則非常慢。 在這種情況下,這將是一個分類問題。

沒有標記的數據,系統從輸入開始,必須在數據中找到結構。 我們實際上沒有目標,只有輸入數據。 好像在示例中我們只有路線和車輛數據,但沒有行程時間數據。

在這種方法中,算法必須通過尋找數據中的隱藏結構來識別類別。 可用於無監督方法的主要工具是 集群 和 關聯規則.

系統接收來自環境的輸入並採取行動。 系統嘗試採取行動以獲得獎勵。 系統將嘗試根據周圍環境的狀態執行優化獎勵的操作。

獎勵系統是通過一個組件實現的,稱為 代理人. 代理決定對環境執行的操作,並從中接收到一個 裡康彭薩 和可能的關於環境狀態的信息,作為所採取的行動的結果。

例如,如果我們想到一個專門用於國際象棋遊戲的系統,代理是決定移動的組件,環境是遊戲本身。 由於代理的每一步移動,遊戲狀態都會發生變化(理解為當前情況、所有棋子的位置,也是對手移動的結果),接收到作為吃掉對手棋子的反饋,因此旨在作為對移動的獎勵。 通過這種方式,代理學習和教育自己。

因此很明顯,機器學習類型之間的選擇取決於上下文。 也就是說,方法的類型是根據可用數據和歷史的可能性來選擇的,該歷史包括對每個案例的情況(輸入)和結果(輸出)的描述。 因此,對於這種類型的數據集,您可以繼續使用監督方法。

另一方面,如果你不可能先驗地知道輸出數據(目標),或者你想發現新的目標,那麼有必要識別輸入數據之間的聯繫,以發現從未經歷過的情況。歷史,或者面對一個不斷發展和反應的環境的學習。 在這種情況下,有必要選擇無監督或強化技術。

Ercole Palmeri: 創新上癮