मशीन लर्निंगला दिलेल्या उदाहरणांच्या संचाच्या (ट्रेनिंग सेट) विरूद्ध लॉस फंक्शनची "मिनिमायझेशन प्रॉब्लेम्स" म्हणून बनवले जाते. हे वैशिष्ट्य मॉडेलद्वारे प्रशिक्षित केलेल्या अंदाजानुसार मूल्ये आणि प्रत्येक उदाहरणाकरिता अपेक्षित मूल्ये यांच्यातील भिन्नता दर्शवते.

प्रशिक्षण लक्ष्यात नसलेल्या घटनांच्या संचावर मॉडेलला योग्य अंदाज लावण्याची क्षमता शिकविणे हे अंतिम लक्ष्य आहे.

एक पद्धत ज्यानुसार अल्गोरिदमच्या विविध श्रेणींमध्ये फरक करणे शक्य आहे, म्हणजे विशिष्ट प्रणालीकडून अपेक्षित आउटपुटचा प्रकार. मशीन शिक्षण.

आम्हाला आढळणार्या मुख्य श्रेणींमध्ये:

वर्गीकरणाचे उदाहरण म्हणजे त्यामध्ये असलेल्या ऑब्जेक्ट्स किंवा विषयांवर आधारित प्रतिमेत एक किंवा अधिक लेबलांची असाइनमेंट;

रंगाच्या प्रतिमेच्या स्वरुपात एखाद्या देखाव्याच्या खोलीतून त्याच्या प्रतिनिधित्वाची किती खोली असते याचा अंदाज घेणे हे प्रतिरोधचे उदाहरण आहे.

खरं तर, प्रश्नातील आउटपुटचे क्षेत्र अक्षरशः असीम आहे, आणि संभाव्यतेच्या काही विशिष्ट संचापुरते मर्यादित नाही;

रेखीय प्रतिरोध आहेवास्तविक मूल्यांचा अंदाज लावण्यासाठी मोठ्या प्रमाणावर वापरले जाणारे मॉडेल जसे की:

आणि सतत चल च्या निकष अनुसरण:

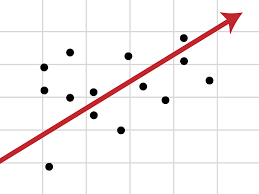

रेखीय रीग्रेशनमध्ये स्वतंत्र व्हेरिएबल्स आणि डिपेंडेंट व्हेरिएबल्समधील संबंध एका रेषेतून केले जाते जे सामान्यत: दोन व्हेरिएबल्समधील संबंध दर्शवते.

तंदुरुस्त रेखाला रीग्रेशन लाइन म्हणून ओळखले जाते आणि Y = a * X + b प्रकाराचे रेखीय समीकरण दर्शविले जाते.

सूत्र एकमेकांशी दोन किंवा अधिक वैशिष्ट्ये संबद्ध करण्यासाठी डेटा इंटरपोलिंगवर आधारित आहे. जेव्हा आपण अल्गोरिदमला एक इनपुट वैशिष्ट्य देता, तेव्हा रिग्रेशन्स इतर वैशिष्ट्य परत करते.

जेव्हा आपल्याकडे एकापेक्षा जास्त स्वतंत्र चल असतात, तर आम्ही खालील प्रमाणे मॉडेल गृहीत धरुन एकाधिक रेषीय रीग्रेशनबद्दल बोलतो:

y = बी0 + बी1x1 + बी2x2 +… + बीnxn

मुळात हे समीकरण सतत अवलंबून चल (y) आणि दोन किंवा अधिक स्वतंत्र चल (x1, x2, x3…) यांच्यातील संबंध स्पष्ट करते.

उदाहरणार्थ, जर इंजिनची शक्ती, सिलिंडर्सची संख्या आणि इंधनाचा वापर लक्षात घेऊन आपण (सीओ 2 उत्सर्जित कार) उत्सर्जन करू इच्छित असाल तर. हे नंतरचे घटक स्वतंत्र व्हेरिएबल्स एक्स 1, एक्स 2 आणि एक्स 3 आहेत. स्थिरांक दोन वास्तविक संख्या आहेत आणि त्यांना मॉडेलच्या अंदाजित रीग्रेशन गुणांक म्हणतात. वाय हे सतत अवलंबून चल आहे, म्हणजे बी 0, बी 1 एक्स 1, बी 2 एक्स 2 इ. ची बेरीज. y एक वास्तविक संख्या असेल.

मल्टीपल रीग्रेशन एनालिसिस ही एक पध्दत आहे जी स्वतंत्र व्हेरिएबल्सवर अवलंबून असलेल्या व्हेरिएबलवर होणारा प्रभाव ओळखण्यासाठी वापरली जाते.

स्वतंत्र व्हेरिएबल्स बदल म्हणून अवलंबित बदल कसे बदलतात हे समजून घेतल्यामुळे वास्तविक परिस्थितीतील बदलांच्या प्रभावांचा किंवा परिणामाचा अंदाज घेता येतो.

एकाधिक रेषीय प्रतिकारांचा वापर करून, वय, लिंग इत्यादी बाबींचा विचार करून बॉडी मास इंडेक्समध्ये बदल होताना रक्तदाब कसा बदलतो हे समजणे शक्य आहे, जेणेकरून असे घडू शकते.

एकाधिक रीग्रेशनसह आम्ही भावी प्रवृत्तींवर अंदाज येऊ शकतो, जसे की तेल किंवा सोन्याच्या भविष्यातील कल.

अखेरीस, एकाधिक रेषीय प्रतिरोध मशीन मशीन आणि कृत्रिम बुद्धिमत्तेच्या क्षेत्रात अधिक स्वारस्य अनुभवत आहे कारण मोठ्या संख्येने अभिलेखांचे विश्लेषण केले जावे अशा बाबतीतही ते परफॉर्मिंग लर्निंग मॉडेल्स प्राप्त करू देते.

लॉजिस्टिक रिग्रेशन एक सांख्यिकीय साधन आहे ज्याचा उद्देश एक किंवा अधिक स्पष्टीकरणात्मक चलांसह द्विपक्षीय निकालाचे मॉडेल बनविणे आहे.

हे सामान्यत: बायनरी समस्यांसाठी वापरले जाते, जेथे फक्त दोन वर्ग आहेत, उदाहरणार्थ होय किंवा नाही, 0 किंवा 1, नर किंवा मादी इ ...

अशा प्रकारे डेटाचे वर्णन करणे आणि बायनरी अवलंबून चल आणि एक किंवा अधिक नाममात्र किंवा सामान्य स्वतंत्र व्हेरिएबल्समधील संबंध स्पष्ट करणे शक्य आहे.

लॉजिस्टिक फंक्शनच्या वापरामुळे परिणाम निश्चित केला जातो, जो संभाव्यतेचा अंदाज लावतो आणि नंतर defiप्राप्त संभाव्यता मूल्याच्या सर्वात जवळचा वर्ग (सकारात्मक किंवा ऋण) समाप्त करतो.

च्या कुटुंबाचे वर्गीकरण करण्याची एक पद्धत म्हणून आम्ही लॉजिस्टिक रीग्रेशनचा विचार करू शकतो पर्यवेक्षी शिक्षण अल्गोरिदम.

सांख्यिकीय पद्धतींचा वापर करून लॉजिस्टिक रीग्रेशन एक परिणाम तयार करण्यास अनुमती देते जे खरं तर दिलेली इनपुट मूल्य दिलेल्या वर्गाची आहे अशी संभाव्यता दर्शवते.

द्विपदीय लॉजिस्टिक रीग्रेशन समस्यांमधे आउटपुट एका वर्गाचे असेल अशी संभाव्यता पी असेल तर ती दुसर्या वर्ग 1-पीशी संबंधित असेल (जिथे पी 0 आणि 1 मधील संख्या आहे कारण ती संभाव्यता दर्शवते).

द्विपक्षीय लॉजिस्टिक रीग्रेशन त्या सर्व प्रकरणांमध्ये चांगले कार्य करते ज्यामध्ये आपण ज्या व्हेरिएबलचा भविष्यवाणी करण्याचा प्रयत्न करीत आहोत ते बायनरी आहे, म्हणजेच ते फक्त दोन मूल्ये गृहित धरू शकतेः मूल्य 1 जे सकारात्मक वर्गाचे प्रतिनिधित्व करते किंवा मूल्य 0 जे नकारात्मक वर्गाचे प्रतिनिधित्व करते.

लॉजिस्टिक रीग्रेशनद्वारे सोडविल्या जाणार्या समस्यांचे उदाहरणः

लॉजिस्टिक रीग्रेशनसह आम्ही भविष्यवाणी करणारे विश्लेषण करू शकतो, जे आपण भाकीत करू इच्छितो (अवलंबून चल) आणि एक किंवा अधिक स्वतंत्र चल, म्हणजे वैशिष्ट्ये. संभाव्यता अंदाज लॉजिस्टिक फंक्शनद्वारे केले जाते.

संभाव्यतेचे नंतर बायनरी मूल्यांमध्ये रूपांतर होते आणि भविष्यवाणी खरी ठरविण्यासाठी, हा निकाल त्या वर्गात नेमला जातो जो वर्ग जवळ आहे की नाही यावर आधारित असतो.

उदाहरणार्थ, जर लॉजिस्टिक फंक्शनचा वापर ०.0,85 परत आला तर त्याचा अर्थ असा आहे की इनपुटने वर्ग १ ला नियुक्त करुन एक सकारात्मक वर्ग तयार केला आहे. उलट जर त्याने ०..1 किंवा त्यापेक्षा अधिक सामान्य मूल्य प्राप्त केले असेल तर <0,4 ..

इनपुट मूल्यांच्या वर्गीकरणाचे मूल्यांकन करण्यासाठी लॉजिस्टिक रीग्रेशन लॉजिस्टिक फंक्शनचा वापर करते.

लॉजिस्टिक फंक्शन, ज्याला सिग्मॉईड असे म्हणतात, ही एक वक्र आहे जी कितीही वास्तविक मूल्य वगळता किती वास्तविक मूल्य घेते आणि त्यास 0 आणि 1 मधील मूल्यामध्ये मॅप करण्यास सक्षम असते. हे कार्यः

ते कुठे आहे:

लॉजिस्टिक रीग्रेशन हे रेखीय प्रतिगमन सारखेच प्रतिनिधित्व म्हणून समीकरण वापरते

इनपुट मूल्य (एक्स) आउटपुट मूल्य (वाई) ची पूर्वानुमान करण्यासाठी वजन किंवा गुणांक मूल्यांचा वापर करून रेषात्मकपणे एकत्र केले जातात. रेखीय प्रतिगमनातील महत्त्वाचा फरक हा आहे की मॉडेलिंग आउटपुट मूल्य हे संख्यात्मक मूल्याऐवजी बाइनरी मूल्य (0 किंवा 1) आहे.

खाली लॉजिस्टिक रीग्रेशन समीकरणाचे उदाहरण आहेः

y = e ^ (बी 0 + बी 1 * एक्स) / (1 + ई ^ (बी 0 + बी 1 * एक्स))

कबूतर:

इनपुट डेटामधील प्रत्येक स्तंभात संबंधित बी गुणांक (एक स्थिर वास्तविक मूल्य) असते जे प्रशिक्षण डेटामधून शिकले जाणे आवश्यक आहे.

आपण मेमरीमध्ये किंवा फाईलमध्ये संग्रहित केलेल्या मॉडेलचे वास्तविक प्रतिनिधित्व समीकरण (बीटा किंवा बी मूल्य) मधील गुणांक आहेत.

लॉजिस्टिक रीग्रेशन मॉडेल डीफॉल्ट वर्गाची संभाव्यता.

एक उदाहरण म्हणून, समजा आपण लोकांच्या लैंगिकतेचे पुरुष किंवा पुरुष म्हणून त्यांची उंची वरून मॉडेलिंग करीत आहोत, प्रथम वर्ग पुरुष असू शकतो आणि एखाद्या व्यक्तीची उंची किंवा त्याहून अधिक दिले जाण्याची शक्यता म्हणून लॉजिस्टिक रीग्रेशन मॉडेल लिहिले जाऊ शकते. औपचारिकरित्याः

पी (लिंग = पुरुष | उंची)

दुसर्या मार्गाने लिहिल्यास, आम्ही प्रीबेबिलिटीचे मॉडेलिंग करत आहोत की इनपुट (X) प्री वर्गाशी संबंधित आहेdefinite (Y = 1), आपण ते असे लिहू शकतो:

पी (एक्स) = पी (वाई = 1 | एक्स)

संभाव्यतेचा अंदाज बांधण्यासाठी संभाव्यतेचे भविष्य सांगणे बायनरी व्हॅल्यूजमध्ये (0 किंवा 1) मध्ये बदलले जाणे आवश्यक आहे.

लॉजिस्टिक रीग्रेशन ही एक रेषीय पद्धत आहे, परंतु लॉजिस्टिक फंक्शनचा वापर करून अंदाज बदलले जातात. याचा परिणाम असा आहे की आपण रेखीय आक्षेपार्हतेसह आवाजाचे रेषीय संयोजन म्हणून अंदाज यापुढे समजून घेऊ शकत नाही, उदाहरणार्थ, वरुन पुढे जात असताना, मॉडेल असे व्यक्त केले जाऊ शकते:

पी (एक्स) = ई ^ (बी ० + बी १ * एक्स) / (१ + ई ^ (बी ० + बी १ * एक्स))

आता आपण खालीलप्रमाणे समीकरण उलट करू शकता. त्यास उलट करण्यासाठी आम्ही एकीकडे ई बाजूला काढून दुस side्या बाजूला नैसर्गिक लॉगरिदम जोडून पुढे जाऊ शकतो.

ln (पी (एक्स) / 1 - पी (एक्स)) = बी 0 + बी 1 * एक्स

अशाप्रकारे आम्हाला हे सत्य मिळते की उजवीकडील आउटपुटची गणना पुन्हा रेखीय आहे (रेखीय रीग्रेशन प्रमाणेच), आणि डावीकडील इनपुट हे डीफॉल्ट वर्गाच्या संभाव्यतेचे लॉगॅरिथम आहे.

संभाव्यतेची गणना इव्हेंटच्या संभाव्यतेच्या प्रमाणात म्हणून केली जाते ज्यात कोणत्याही घटनेच्या संभाव्यतेद्वारे विभाजित केलेले नाही, उदा. 0,8 / (1-0,8) ज्याचा निकाल 4 आहे. म्हणून आम्ही त्याऐवजी लिहू शकतो:

ln (शक्यता) = बी 0 + बी 1 * एक्स

संभाव्यतेचे लॉग-ट्रान्सफॉर्मेशन असल्यामुळे आम्ही या डाव्या बाजूने लॉग-ऑडियस किंवा प्रॉबिट म्हणतो.

आपण घातांक उजवीकडे परत करू आणि हे लिहू शकतो:

संभाव्यता = ई ^ (बी 0 + बी 1 * एक्स)

हे सर्व आपल्याला हे समजण्यास मदत करते की मॉडेल अद्याप इनपुटचे एक रेषीय संयोजन आहे, परंतु हे रेखीय संयोजन पूर्व वर्गाच्या लॉग संभाव्यतेचा संदर्भ देते.defiनीता

लॉजिस्टिक रीग्रेशन अल्गोरिदमचे गुणांक (बीटा किंवा बी व्हॅल्यू) शिकण्याच्या अवस्थेत अनुमानित केले जातात. हे करण्यासाठी, आम्ही जास्तीत जास्त संभाव्यतेचा अंदाज वापरतो.

जास्तीत जास्त संभाव्यता अंदाज हे अनेक मशीन लर्निंग अल्गोरिदमद्वारे वापरले जाणारे शिक्षण अल्गोरिदम आहे. मॉडेलच्या परिणामी गुणांक प्री-स्कूल वर्गासाठी 1 (उदा. पुरुष) च्या अगदी जवळ असलेल्या मूल्याचा अंदाज लावतातdefinite आणि इतर वर्गासाठी 0 च्या अगदी जवळ असलेले मूल्य (उदा. महिला). लॉजिस्टिक रिग्रेशनची कमाल शक्यता ही गुणांक (बीटा किंवा ओब व्हॅल्यूज) साठी मूल्ये शोधण्याची एक प्रक्रिया आहे जी डेटामधील संबंधित मॉडेलद्वारे अंदाज केलेल्या संभाव्यतेमधील त्रुटी कमी करते (उदा. डेटा प्राथमिक वर्ग असल्यास संभाव्यता 1) .

आम्ही प्रशिक्षण डेटासाठी सर्वोत्तम गुणांक मूल्यांना अनुकूलित करण्यासाठी एक लघुकरण अल्गोरिदम वापरू. हे सहसा कार्यक्षम अंकीय ऑप्टिमायझेशन अल्गोरिदम वापरून व्यवहारात अंमलात आणले जाते.

गेल्या सोमवारी, फायनान्शिअल टाईम्सने OpenAI सह करार जाहीर केला. FT ने त्याच्या जागतिक दर्जाच्या पत्रकारितेचा परवाना…

लाखो लोक स्ट्रीमिंग सेवांसाठी पैसे देतात, मासिक सदस्यता शुल्क भरतात. असे सामान्य मत आहे की आपण…

Veeam द्वारे Coveware सायबर खंडणी घटना प्रतिसाद सेवा प्रदान करणे सुरू ठेवेल. Coveware फॉरेन्सिक आणि उपाय क्षमता प्रदान करेल…

वनस्पती व्यवस्थापनासाठी नाविन्यपूर्ण आणि सक्रिय दृष्टीकोनसह, भविष्यसूचक देखभाल तेल आणि वायू क्षेत्रात क्रांती घडवत आहे.…