Машинното обучение се формулира като „проблеми с минимизиране“ на функция на загуба спрямо даден набор от примери (набор от тренировки). Тази функция изразява несъответствието между стойностите, предвидени от модела, който се обучава, и очакваните стойности за всеки пример.

Крайната цел е да научим модела да умее да прогнозира правилно на набор от случаи, които не присъстват в тренировъчния набор.

Метод, според който е възможно да се разграничат различни категории алгоритъм, е типът изход, очакван от определена система от машинно обучение.

Сред основните категории откриваме:

Пример за класификация е присвояване на един или повече етикети на изображение въз основа на съдържащите се в него обекти или предмети;

Пример за регресия е оценката на дълбочината на една сцена от нейното представяне под формата на цветно изображение.

Всъщност областта на въпросния изход е почти безкрайна и не се ограничава до определен дискретен набор от възможности;

Линейна регресия ешироко използван модел, използван за оценка на реални стойности като:

и следва критерия за непрекъснати променливи:

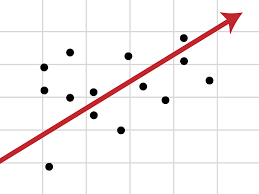

При линейна регресия връзка между независими променливи и зависими променливи се следва през линия, която обикновено представлява връзката между двете променливи.

Подходящата линия е известна като регресионна линия и е представена от линейно уравнение от типа Y = a * X + b.

Формулата се основава на интерполиране на данни за свързване на две или повече характеристики помежду си. Когато дадете на алгоритъма входна характеристика, регресията връща другата характеристика.

Когато имаме повече от една независима променлива, тогава говорим за множествена линейна регресия, като приемаме модел като следния:

y=b0 + b1x1 + b2x2 +… + Bnxn

На практика уравнението обяснява връзката между непрекъсната зависима променлива (y) и две или повече независими променливи (x1, x2, x3…).

Например, ако искахме да изчислим емисиите на CO2 на автомобил (зависима променлива у), като се има предвид мощността на двигателя, броя на цилиндрите и разхода на гориво. Тези последни фактори са независимите променливи x1, x2 и x3. Константите bi са реални числа и се наричат прогнозни регресионни коефициенти на модела. Y е непрекъснато зависимата променлива, т.е. сумата от b0, b1 x1, b2 x2 и т.н. y ще бъде реално число.

Множественият регресионен анализ е метод, използван за идентифициране на ефекта, който независимите променливи имат върху зависима променлива.

Разбирането на това как зависимата променлива се променя, както се променят независимите променливи, ни позволява да прогнозираме ефектите или въздействията от промените в реални ситуации.

Използвайки множествена линейна регресия, е възможно да разберете как се променя кръвното налягане, тъй като индексът на телесната маса се променя, като се вземат предвид фактори като възраст, пол и др., Като по този начин се предполага какво може да се случи.

С многократна регресия можем да получим оценки за ценовите тенденции, като бъдещата тенденция за нефт или злато.

И накрая, множествената линейна регресия намира по-голям интерес в областта на машинното обучение и изкуствения интелект, тъй като позволява да се получат работещи модели на обучение дори в случай на голям брой записи, които трябва да бъдат анализирани.

Логистичната регресия е статистически инструмент, който има за цел да моделира биномиален резултат с една или повече обяснителни променливи.

Обикновено се използва за двоични проблеми, където има само два класа, например Да или Не, 0 или 1, мъжки или женски и т.н. ...

По този начин е възможно да се опишат данните и да се обясни връзката между двоична зависима променлива и една или повече независими номинални или порядъчни променливи.

Резултатът се определя благодарение на използването на логистична функция, която оценява вероятност и след това defiзавършва най-близкия клас (положителен или отрицателен) до получената вероятностна стойност.

Можем да разгледаме логистичната регресия като метод за класифициране на семейството на контролирани алгоритми за обучение.

Използвайки статистически методи, логистичната регресия позволява да се генерира резултат, който всъщност представлява вероятност дадена входна стойност да принадлежи на даден клас.

При проблеми с биномиална логистична регресия вероятността изходът да принадлежи на един клас ще бъде P, докато тя принадлежи към другия клас 1-P (където P е число между 0 и 1, защото изразява вероятност).

Биномиалната логистична регресия работи добре във всички онези случаи, в които променливата, която се опитваме да предвидим, е двоична, тоест тя може да приеме само две стойности: стойността 1, която представлява положителния клас, или стойността 0, която представлява отрицателния клас.

Примери за проблеми, които могат да бъдат решени чрез логистична регресия са:

С логистична регресия можем да направим прогнозен анализ, измервайки връзката между това, което искаме да прогнозираме (зависима променлива), и една или повече независими променливи, т.е. характеристики. Оценката на вероятността се извършва чрез логистична функция.

Вероятностите впоследствие се трансформират в двоични стойности и за да стане прогнозата реална, този резултат се присвоява на класа, към който принадлежи, въз основа на това дали е близо до самия клас или не.

Например, ако приложението на логистичната функция връща 0,85, това означава, че входът е генерирал положителен клас, като го е присвоил на клас 1. Обратно, ако е получил стойност като 0,4 или по-общо <0,5 ..

Логистичната регресия използва логистичната функция за оценка на класификацията на входните стойности.

Логистичната функция, наричана още сигмоидна, е крива, способна да приеме произволен брой реална стойност и да я съпостави до стойност между 0 и 1, с изключение на крайности. Функцията е:

когато:

Логистичната регресия използва уравнение като представяне, подобно на линейна регресия

Входните стойности (x) се комбинират линейно, като се използват тегла или коефициентни стойности, за да се предскаже изходна стойност (y). Ключова разлика от линейната регресия е, че моделираната изходна стойност е двоична стойност (0 или 1), а не числова стойност.

По-долу е даден пример за уравнение на логистична регресия:

y = e^(b0 + b1 * x) / (1 + e^(b0 + b1 * x))

Къде:

Всяка колона във входните данни има асоцииран b коефициент (постоянна реална стойност), който трябва да бъде научен от данните за обучение.

Действителното представяне на модела, който бихте запазили в паметта или файл, са коефициентите в уравнението (бета или b стойност).

Логистичната регресия моделира вероятността за класа по подразбиране.

Като пример, нека предположим, че моделираме пола на хората като мъже или жени от тяхната височина, първият клас може да бъде мъжки, а логистичният регресионен модел може да бъде написан като вероятност да бъдем мъже, като се има предвид ръст на човек или повече. официално:

P (пол = мъж | ръст)

Написано по друг начин, ние моделираме вероятността вход (X) да принадлежи към класа predefiкрая (Y = 1), можем да го запишем като:

P(X) = P(Y = 1 | X)

Предсказването на вероятността трябва да се трансформира в двоични стойности (0 или 1), за да може действително да се предвиди вероятност.

Логистичната регресия е линеен метод, но прогнозите се трансформират с помощта на логистичната функция. Въздействието на това е, че вече не можем да разберем прогнозите като линейна комбинация от входове, както можем с линейна регресия, например, продължавайки отгоре, моделът може да се изрази като:

p(X) = e ^ (b0 + b1 * X) / (1 + e ^ (b0 + b1 * X))

Сега можем да обърнем уравнението по следния начин. За да го обърнем, можем да продължим, като премахнем e от едната страна, като добавим естествен логаритъм от другата страна.

ln (p (X) / 1 - p (X)) = b0 + b1 * X

По този начин получаваме факта, че изчисляването на изхода отдясно отново е линеен (точно като линейна регресия), а входът отляво е логаритъм на вероятността на класа по подразбиране.

Вероятностите се изчисляват като съотношение на вероятността на събитието, разделено на вероятността да няма събитие, напр. 0,8 / (1-0,8), чийто резултат е 4. Така че вместо това бихме могли да напишем:

ln (коефициент) = b0 + b1 * X

Тъй като вероятностите са преобразувани от журнал, ние наричаме това лявостранни лог-коефициенти или пробит.

Можем да върнем експонента вдясно и да го запишем като:

вероятност = e ^ (b0 + b1 * X)

Всичко това ни помага да разберем, че наистина моделът все още е линейна комбинация от входовете, но че тази линейна комбинация се отнася до логаритмичните вероятности на предварителния класdefiнита.

Коефициентите (бета или b стойности) на алгоритъма за логистична регресия се оценяват във фазата на обучение. За целта използваме максимална оценка на вероятността.

Оценката на максималната вероятност е алгоритъм за обучение, използван от няколко алгоритми за машинно обучение. Коефициентите, получени от модела, предвиждат стойност, много близка до 1 (напр. мъже) за предучилищния класdefinite и стойност, много близка до 0 (напр. женски) за другия клас. Максималната вероятност за логистична регресия е процедура за намиране на стойности за коефициенти (бета или ob стойности), които минимизират грешката във вероятностите, предвидени от модела спрямо тези в данните (напр. вероятност 1, ако данните са основният клас) .

Ще използваме алгоритъм за минимизиране, за да оптимизираме най-добрите стойности на коефициента за обучителните данни. Това често се прилага на практика, като се използва ефикасен алгоритъм за цифрово оптимизиране.

Развитието на фини двигателни умения чрез оцветяване подготвя децата за по-сложни умения като писане. Оцветявам…

Военноморският сектор е истинска световна икономическа сила, която се е насочила към пазар от 150 милиарда...

Миналия понеделник Financial Times обяви сделка с OpenAI. FT лицензира своята журналистика от световна класа...

Милиони хора плащат за стрийминг услуги, като плащат месечни абонаментни такси. Разпространено е мнението, че вие…